环境准备

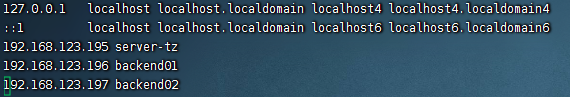

首先做免密登录,三台虚拟机分别生成秘钥文件

//三台都需要操作

ssh-keygen -t rsa

//三台都需要打以下命令,进行秘钥分发

[root@tz1-123 ~]# ssh-copy-id tz1-123

[root@tz1-123 ~]# ssh-copy-id tz2-123

[root@tz1-123 ~]# ssh-copy-id tz3-123修改防火墙设置后,查看三台虚拟机防火墙状态

//三台,禁止防火墙自启,立即生效

systemctl disable firewalld --now安装JDK(3台),首先上传安装包到根目录,然后解压在/usr/lib/jvm

//修改环境变量/etc/profile

JAVA_HOME=/usr/lib/jvm/jdk1.8.0_152

JRE_HOME=$JAVA_HOME/jre

CLASS_PATH=.:$JAVA_HOME/lib/dt.jar:$JAVA_HOME/lib/tools.jar:$JRE_HOME/lib

PATH=$PATH:$JAVA_HOME/bin:$JRE_HOME/bin

export JAVA_HOME JRE_HOME CLASS_PATH PATH部署

首先将Hadoop软件包上传至/root中,并解压在/usr/local/src/下

修改core-site.xml

//将以下内容加在<configuration></configuration>之间

<property>

<!--hdfs地址-->

<name>fs.defaultFS</name>

<value>hdfs://tz1-123:9000</value>

</property>

<!-- 指定hadoop运行时产生文件的存储目录 -->

<property>

<name>hadoop.tmp.dir</name>

<value>/usr/local/src/hadoop/data/tmp</value>

</property>

修改hadoop-env.sh

//在最后添加以下一条

export JAVA_HOME=/usr/lib/jvm/jdk1.8.0_152

修改hdfs-site.xml

//将以下内容加在<configuration></configuration>之间

<!--副本集个数-->

<property>

<name>dfs.replication</name>

<value>3</value>

</property>

<!--SecondaryNamenode的http地址-->

<property>

<name>dfs.namenode.secondary.http-address</name>

<value>tz3-123:50090</value>

</property>

修改yarn-env.sh

//在最后添加以下一条

export JAVA_HOME=/usr/lib/jvm/jdk1.8.0_152

修改yarn-site.xml

//将以下内容加在<configuration></configuration>之间

<!-- reducer获取数据的方式 -->

<property>

<name>yarn.nodemanager.aux-services</name>

<value>mapreduce_shuffle</value>

</property>

<!-- 指定YARN的ResourceManager的地址 -->

<property>

<name>yarn.resourcemanager.hostname</name>

<value>tz2-123</value>

</property>

修改mapred-env.sh

//在最后添加以下一条

export JAVA_HOME=/usr/lib/jvm/jdk1.8.0_152修改mapred-site.xml

[root@tz1-123 hadoop]# cp mapred-site.xml.template mapred-site.xml

[root@tz1-123 hadoop]# vim mapred-site.xml

//将以下内容加在<configuration></configuration>之间

<!-- 指定mr运行在yarn上 -->

<property>

<name>mapreduce.framework.name</name>

<value>yarn</value>

</property>修改slaves

[root@tz1-123 hadoop]# vim slaves

tz1-123

tz2-123

tz3-123分发Hadoop软件包

[root@tz1-123 hadoop]# scp -r /usr/local/src/hadoop tz2-123:/usr/local/src/

[root@tz1-123 hadoop]# scp -r /usr/local/src/hadoop tz3-123:/usr/local/src/修改/etc/profile

//在最后添加以下内容

export HADOOP_HOME=/usr/local/src/hadoop

export PATH=$PATH:$HADOOP_HOME/bin:$HADOOP_HOME/sbin

//修改完成后再次分发,并加在环境变量

[root@tz1-123 hadoop]# source /etc/profile

[root@tz1-123 hadoop]# scp /etc/profile tz2-123:/etc/

[root@tz1-123 hadoop]# scp /etc/profile tz3-123:/etc/在tz1-123(master)上格式化namenode

hdfs namenode -format

启动集群并测试

[hadoop@tz1-123 ~]$ start-dfs.sh

[hadoop@tz2-123 ~]$ start-yarn.sh

[root@tz1-123 hadoop]# jps

8096 NameNode

24690 NodeManager

24882 Jps

8293 DataNode

[root@tz2-123 ~]# jps

30709 NodeManager

24086 DataNode

30567 ResourceManager

781 Jps

[root@tz3-123 ~]# jps

23988 DataNode

604 Jps

30494 NodeManagerHDFS Shell操作

HDFS Shell操作以hadoop fs或hdfs dfs开头。

#查看某路径下文件夹

hadoop fs -ls HDFS路径

#在HDFS上创建文件夹

hadoop fs -mkdir HDFS文件夹路径

#在HDFS上创建文件夹(上级目录不存在)

hadoop fs -mkdir -p HDFS文件夹路径

#将本地文件上传到HDFS上

hadoop fs -put 本地文件路径 HDFS路径

#查看集群文件的内容

hadoop fs -cat HDFS文件路径

#从HDFS上下载文件到本地

hadoop fs -get HDFS文件路径 本地路径

#删除HDFS上空文件夹

hadoop fs -rmdir HDFS文件夹路径

#删除HDFS上的非空文件夹

hadoop fs -rm -r HDFS文件夹路径

#删除HDFS上的文件

hadoop fs -rm HDFS文件路径

#将HDFS上的路径剪切至另一个路径下

hadoop fs -mv HDFS源路径 HDFS目标路径

#将HDFS上的路径复制到另一个路径下

hadoop fs -cp HDFS源路径 HDFS目标路径

#在HDFS上创建一个文件

hadoop fs -touchz HDFS路径我的博客即将同步至腾讯云开发者社区,邀请大家一同入驻:https://cloud.tencent.com/developer/support-plan?invite_code=35n3trqr2ug48

]]>